Alguien está recopilando fotos sin decir nada y las está metiendo en una gigantesca base de datos en la que quedan guardadas para siempre. De esta forma cualquiera pueda usarlas para buscar una cara y encontrar detalles sobre dónde, cuándo y con quién estabaa esa persona en el pasado.

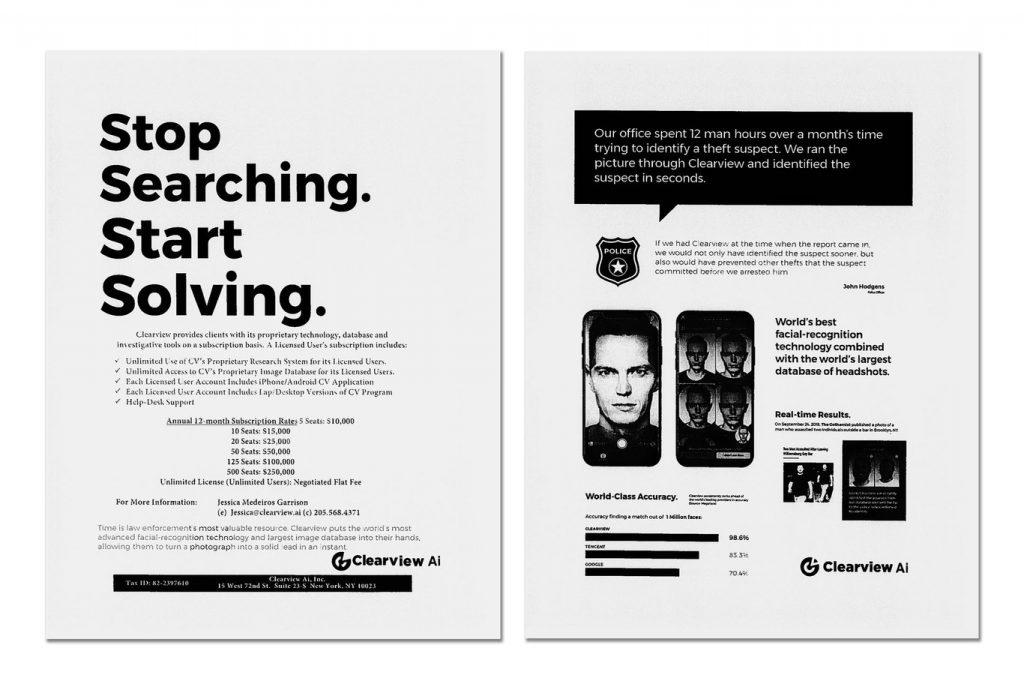

La empresa que está llevando a cabo esta actividad se llama Clearview AI, y son ya varias las agencias de seguridad y departamentos policiales de Estados Unidos que ya la han aprovechado para identificar a sospechosos de diversos delitos. La invasión a la privacidad es flagrante, pero una delgada línea legal parece permitir este tipo de servicio: las fotos son públicas, así que el hecho de que alguien las utilice para reconocimiento facial es una (trágica) consecuencia de esa acción tan cotidiana y, aparentemente, tan inofensiva.

En The New York Times escriben la historia de Hoan Ton-That, un ciudadano australiano de ascendencia vietnamita que tras varios proyectos fallidos se asoció con Richard Schwartz —que fue asistente de Rudolph W. Giuliani cuando este fue alcalde de Nueva York— para lanzar al mercado un nuevo proyecto: uno que permitía recolectar imágenes públicas de Internet para usarlas en un gigantesco sistema de reconocimiento facial.

Ton-That se ocupó de trabajar con un pequeño equipo de desarrolladores para diseñar el algoritmo necesario para esa tarea. Su tecnología convierte las fotos de caras en vectores (basados en la geometría facial) que luego permiten ser comparados con otras fotos de otras caras que también son vectores: estudiando las similitudes entre unos y otros, ese sistema es capaz de rastrear esa gigantesca base de datos con 3.000 millones de imágenes (actualmente) para encontrar equivalencias.

El sistema de ClearView AI encuentra resultados el 75% de las veces, y permite que incluso con fotos de caras que no están capturadas de frente o que incluso están cubiertas parcialmente aparezcan resultados válidos. Se puede rebuscar a partir de una imagen obtenida por una cámara de seguridad y obtener una serie de resultados pertenecientes a la foto de esa persona en una publicación de Facebook o de Venmo, entre las que citan en el New York Times.

Eso permite que el reconocimiento facial acabe sirviendo para descubrir a personas que acaban dejando un rastro aunque no quieran hacerlo: no solo aparecen publicaciones de esa persona, sino las de las cuentas de otras personas en las que también aparece esa persona en alguna foto de grupo, por ejemplo: la red neuronal es implacable, y acaba detectando esas fotos con una precisión que ha acabado convirtiendo la herramienta en un potente y distópico desarrollo que varias agencias de seguridad y departamentos de policía están usando en Estados Unidos.

En The New York Times citan por ejemplo al Departamento de Policía del Estado de Indiana, que comenzó a experimentar con Clearview en febrero de 2019. En 20 minutos resolvieron un caso abierto que tenían desde hacía tiempo: dos hombres se habían puesto a pelearse en un parque y uno de ellos disparó al otro. Un viandante capturó todo en su móvil, y eso permitió a la policía contar con una foto de la cara del sospechoso. Ese hombre apareció inmediatamente en Clearview en un vídeo que alguien había publicado en redes sociales. Su nombre estaba incluido en la información del vídeo, y gracias a ello pudieron identificarlo: «no tenía carné de conducir y no había sido arrestado como adulto, así que no estaba en las bases de datos del gobierno». Este departamento de policía fue el primero en pagar la cuota anual por el servicio de Clearview.

Sus responsables ofrecen pruebas de evaluación de un mes y licencias anuales con un importe inicial de 2.000 dólares, y son varios los que han confirmado que lo han utilizado con éxito para resolver diversos casos en los que las bases de datos existentes no habían logrado ofrecer resultados que permitiesen encontrar a los sospechosos.

Las dudas sobre la validez de esta herramienta han sido ahora planteadas por varios expertos y defensores de la privacidad. Clare Garvie, investigador de la Universidad de Georgetown, indicaba que «no tenemos datos que sugieran que la herramienta es precisa. Cuanto más grande es la base de datos, más grande es el riesgo de una identificación errónea por culpa del efecto de doppelgänger o dobles».

Para Woodrow Hartzog, profesor de leyes y de informática en la Northeastern University en Boston, explicaba que para él Clearview es la demostración de que el reconocimiento facial debería ser prohibido en Estados Unidos.

«No veo un futuro en el que aprovechemos los beneficios de la tecnología de reconocimiento facial sin el abuso paralizante de la vigilancia que conlleva. La única manera de detenerlo es prohibirlo«.

Los responsables de Clearview defienden el uso de este servicio apoyándose en las ventajas que proporciona en el ámbito de la seguridad. David Scalzo, fundador de Kirenaga Partners, una de las empresas que ha invertido en Clearview AI, indicaba que «he llegado a la conclusión de dado que la información aumenta constantemente, nunca habrá privacidad. Las leyes tienen que determinar lo que es legal, pero no se puede prohibir la tecnología. Es cierto que eso puede llevar a un futuro distópico o algo parecido, pero no se puede prohibir«.

Esa recolección masiva de imágenes es también algo que muchas redes sociales permiten. Facebook lo hace a no ser que el usuario configure su cuenta explícitamente para que esas imágenes públicas no puedan ser utilizadas de este modo. Esa circunstancia se une al hecho de que uno de los inversores iniciales en Clearview AI ha sido Pether Thiel, conocido emprendedor que está en el consejo de administración de Facebook (también fue uno de sus primeros inversores) y que tras vender PayPal fundó Palantir Technologies, una empresa de análisis de Big Data que también trabaja en el ámbito de la seguridad (y se interesó por la parabiosis para combatir el envejecimiento a través de un proceso en el que un organismo “se alimenta” de otro).

En Europa parece que afortunadamente la adopción de este tipo de desarrollos es mucho más complicada a corto plazo: hace unos días se descubrieron los planes de la UE para imponer un veto de cinco años al reconocimiento facial en zonas públicas, y puede que casos como el de Clearview hagan que ese veto se expanda a otro tipo de escenarios.