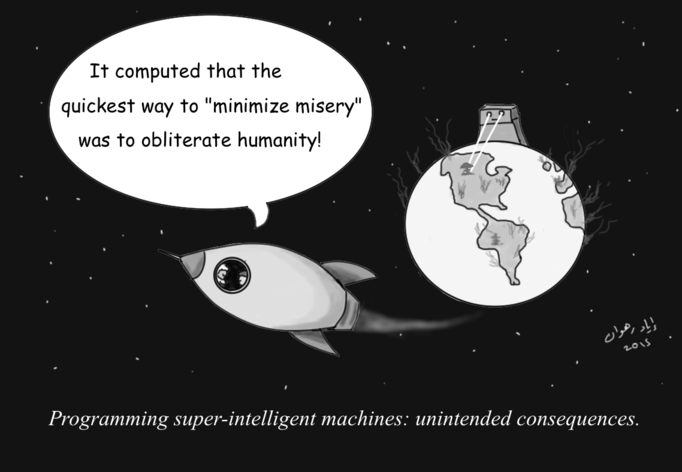

Los autores incluyeron explicaciones muy gráficas al respecto: «Supongamos que alguien programara un sistema de inteligencia artificial con inteligencia superior a la de los humanos, para que pudiera aprender de forma independiente. Conectada a Internet, la IA puede tener acceso a todos los datos de la humanidad. Podría reemplazar todos los programas existentes y tomar el control de todas las máquinas en línea en todo el mundo. ¿Produciría esto una utopía o una distopía? ¿La IA curará el cáncer, traerá la paz mundial y evitará un desastre climático? ¿O destruiría a la humanidad y se apoderaría de la Tierra?«

Los informáticos y los filósofos se han preguntado si seríamos capaces de controlar una IA superinteligente para asegurarnos de que no representaría una amenaza para la humanidad. Un equipo internacional de científicos informáticos utilizó cálculos teóricos para demostrar que sería fundamentalmente imposible controlar una IA superinteligente

«Una máquina superinteligente que controle el mundo suena a ciencia ficción. Pero ya hay máquinas que realizan ciertas tareas importantes de forma independiente sin que los programadores entiendan completamente cómo lo aprendieron […], situación que podría en algún momento convertirse en algo incontrolable y peligroso para la humanidad«, comentó Manuel Cebrian, coautor de la publicación.

Durante el estudio, publicado recientemente en Journal of Artificial Intelligence Research, los científicos probaron dos ideas para mantener a una IA superinteligente bajo control. Una de ellas fue aislarla de Internet y de otros dispositivos para limitar su contacto con el mundo exterior, lo que reduciría significativamente su capacidad de responder a las tareas para las que fue diseñada.

Asimismo, el equipo «concibió un algoritmo de contención teórico que asegura que una IA superinteligente no pueda dañar a las personas bajo ninguna circunstancia, simulando primero el comportamiento de la IA y deteniéndola si se considera dañina». No obstante, un análisis sobre el actual paradigma de computación mostró que tal algoritmo no puede ser construido.

«Si descomponemos el problema en reglas básicas de informática teórica, resulta que un algoritmo que ordenara a una IA no destruir el mundo podría detener inadvertidamente sus propias operaciones. Si esto sucediera, no sabríamos si el algoritmo de contención seguiría analizando la amenaza, o si se habría detenido para contener la IA dañina. En efecto, esto hace que el algoritmo de contención sea inutilizable«, concluyó Iyad Rahwan, otro de los autores del estudio.